原文作者:Jiaheng Zhang

随着人工智能(AI)在医疗、金融、自动驾驶等关键领域的深入落地,保障机器学习(ML)推理过程的可靠性、透明性和安全性,正变得前所未有地重要。

然而,传统的机器学习服务往往像“黑箱”一样运行,用户只能看到结果,难以验证过程。这种不透明性让模型服务容易暴露在风险之下:

-

模型被盗用、

-

推理结果被恶意篡改、

-

用户数据面临隐私泄露风险。

ZKML(零知识机器学习)为这一挑战提供了全新的密码学解法。它依托零知识证明(ZKPs)技术,赋予机器学习模型可加密验证的能力:证明一项计算已被正确执行,而无需透露其中的敏感信息。

换句话说,ZKPs 允许服务提供者向用户证明:

“你所获得的推理结果,确实是我用训练好的模型跑出来的——但我不会泄露任何模型参数。”

这意味着,用户可以信任推理结果的真实性,而模型的结构和参数(往往是高价值资产)则始终保持私密。

zkPyTorch

Polyhedra Network 重磅推出 zkPyTorch —— 一款专为零知识机器学习(ZKML)打造的革命性编译器,旨在打通主流 AI 框架与 ZK 技术之间的最后一公里。

zkPyTorch 将 PyTorch 强大的机器学习能力与前沿的零知识证明引擎深度融合,AI 开发者无需更改编程习惯,也无需学习全新的 ZK 语言,即可在熟悉的环境中,构建具备可验证性的 AI 应用。

这款编译器能够自动将高层次的模型操作(如卷积、矩阵乘法、ReLU、softmax 和注意力机制)转译为可被加密验证的 ZKP 电路,并结合 Polyhedra 自研的 ZKML 优化套件,对主流推理路径进行智能压缩与加速,确保电路的正确性与计算效率双重兼得。

打造可信 AI 生态的关键基础设施

当今的机器学习生态系统,正面临数据安全、计算可验证性和模型透明度等多重挑战。尤其在医疗、金融、自动驾驶等关键行业,AI 模型不仅涉及大量敏感个人信息,还承载着高价值的知识产权与核心商业机密。

零知识机器学习(ZKML)应运而生,成为解决这一困局的重要突破。通过零知识证明(ZKP)技术,ZKML 可在不泄露模型参数或输入数据的前提下,完成模型推理的完整性验证——既守住隐私,又保障可信。

但现实中,ZKML 开发往往门槛极高,需要深厚的密码学背景,远非传统 AI 工程师所能轻松驾驭。

这正是 zkPyTorch 的使命所在。它为 PyTorch 与 ZKP 引擎之间搭起了一座桥梁,让开发者用熟悉的代码构建具备隐私保护与可验证性的 AI 系统,无需重新学习复杂的密码学语言。

通过 zkPyTorch,Polyhedra Network 正在显著降低 ZKML 的技术壁垒,推动可扩展、可信任的 AI 应用走入主流,重构 AI 安全与隐私的新范式。

zkPyTorch 工作流程

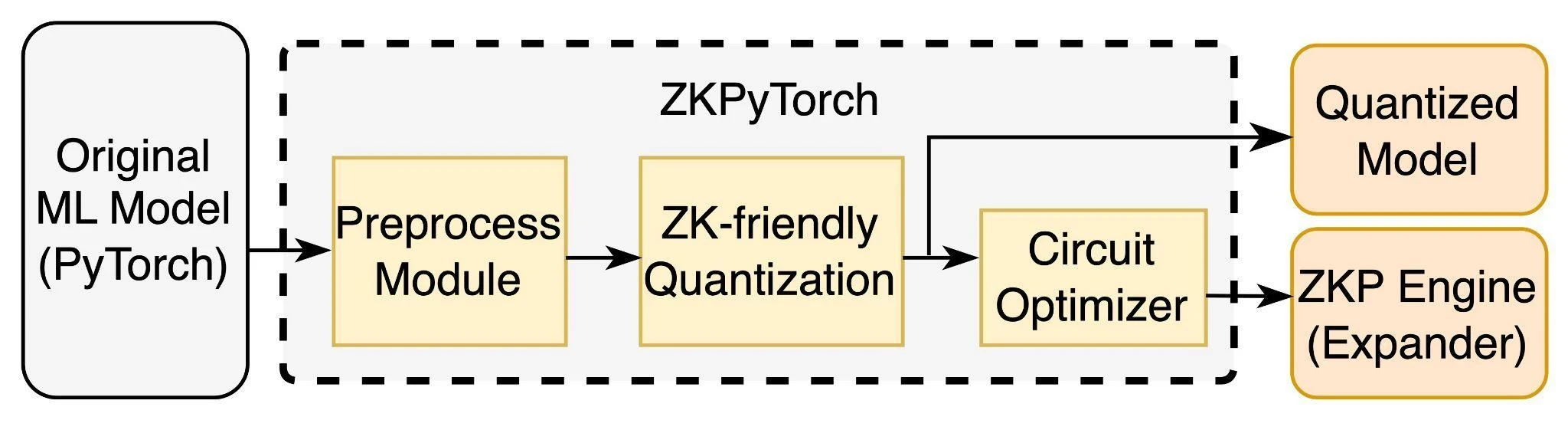

图 1 :ZKPyTorch 的整体架构概览

如图 1 所示,zkPyTorch 通过精心设计的三大模块,将标准 PyTorch 模型自动转换为兼容 ZKP(零知识证明)的电路。这三大模块包括:预处理模块、零知识友好量化模块,以及电路优化模块。

这一流程无需开发者掌握任何加密电路或专用语法:开发者只需使用标准 PyTorch 编写模型,zkPyTorch 即可将其转化为可被如 Expander 等零知识证明引擎识别的电路,生成对应的 ZK 证明。这种高度模块化的设计,大幅降低了 ZKML 的开发门槛,使 AI 开发者无需切换语言或学习密码学,也能轻松构建高效、安全、可验证的机器学习应用。

模块一:模型预处理

在第一阶段,zkPyTorch 会将 PyTorch 模型转换为结构化的计算图,采用开放神经网络交换格式(ONNX)。ONNX 是业界广泛采用的中间表示标准,能够统一表示各类复杂的机器学习操作。通过这一预处理步骤,zkPyTorch 能够理清模型结构、拆解核心计算流程,为后续生成零知识证明电路打下坚实基础。

模块二:ZKP 友好量化

量化模块是 ZKML 系统中的关键一环。传统机器学习模型依赖浮点运算,而 ZKP 环境更适合有限域中的整数运算。zkPyTorch 采用专为有限域优化的整数量化方案,将浮点计算精确映射为整数计算,同时将不利于 ZKP 的非线性操作(如 ReLU、Softmax)转换为高效的查找表形式。

这一策略不仅大幅减少了电路复杂度,还在确保模型精度的前提下,提升了整个系统的可验证性与运行效率。

模块三:分层电路优化

zkPyTorch 在电路优化方面采用多层次策略,具体包括:

-

批处理优化

针对序列化计算特别设计,通过一次性处理多个推理步骤,大幅降低计算复杂度和资源消耗,尤其适用于 Transformer 等大型语言模型的验证场景。 -

原语操作加速

结合快速傅里叶变换(FFT)卷积与查找表技术,有效提升卷积、Softmax 等基础运算的电路执行速度,从根本上增强整体计算效率。 -

并行电路执行

充分发挥多核 CPU 和 GPU 的算力优势,将矩阵乘法等重负载计算拆分为多个子任务并行执行,显著提升零知识证明生成的速度与扩展能力。

深度技术探讨

有向无环图(DAG)

zkPyTorch 采用有向无环图(DAG)来管理机器学习的计算流程。DAG 结构能够系统化地捕捉复杂的模型依赖关系,如图 2 所示,图中每个节点代表一个具体的操作(如矩阵转置、矩阵乘法、除法和 Softmax),而边则精确描述了这些操作之间的数据流向。

这种清晰且结构化的表示方式,不仅极大便利了调试过程,也有助于性能的深入优化。DAG 的无环特性避免了循环依赖,确保了计算顺序的高效且可控执行,这对于优化零知识证明电路的生成至关重要。

此外,DAG 使 zkPyTorch 能够高效处理诸如 Transformer 和残差网络(ResNet)等复杂模型架构,这些模型通常具有多路径、非线性的复杂数据流,DAG 的设计正好契合其计算需求,保证了模型推理的准确性与高效性。

图 2 :机器学习模型以有向无环图(DAG)形式表示的示例

高级量化技术

在 zkPyTorch 中,高级量化技术是将浮点计算转化为适用于零知识证明(ZKP)系统中高效有限域算术的整数运算的关键步骤。zkPyTorch 采用静态整数量化方法,精心设计以兼顾计算效率与模型精度,确保在生成证明时既快速又准确。

这一量化过程包含严格的校准,精准确定最佳量化尺度,用以有效表示浮点数,避免溢出和精度大幅损失。针对 ZKP 特有的非线性运算挑战(例如 Softmax 和层归一化),zkPyTorch 创新性地将这些复杂函数转化为高效的查表操作。

这种策略不仅大幅提升了证明生成的效率,也确保生成的证明结果与高精度量化模型的输出完全一致,兼顾了性能与可信度,推动了可验证机器学习的实用化进程。

多级电路优化策略

zkPyTorch 采用了高度精密的多层次电路优化体系,从多个维度出发,确保零知识推理在效率与可扩展性上的极致表现:

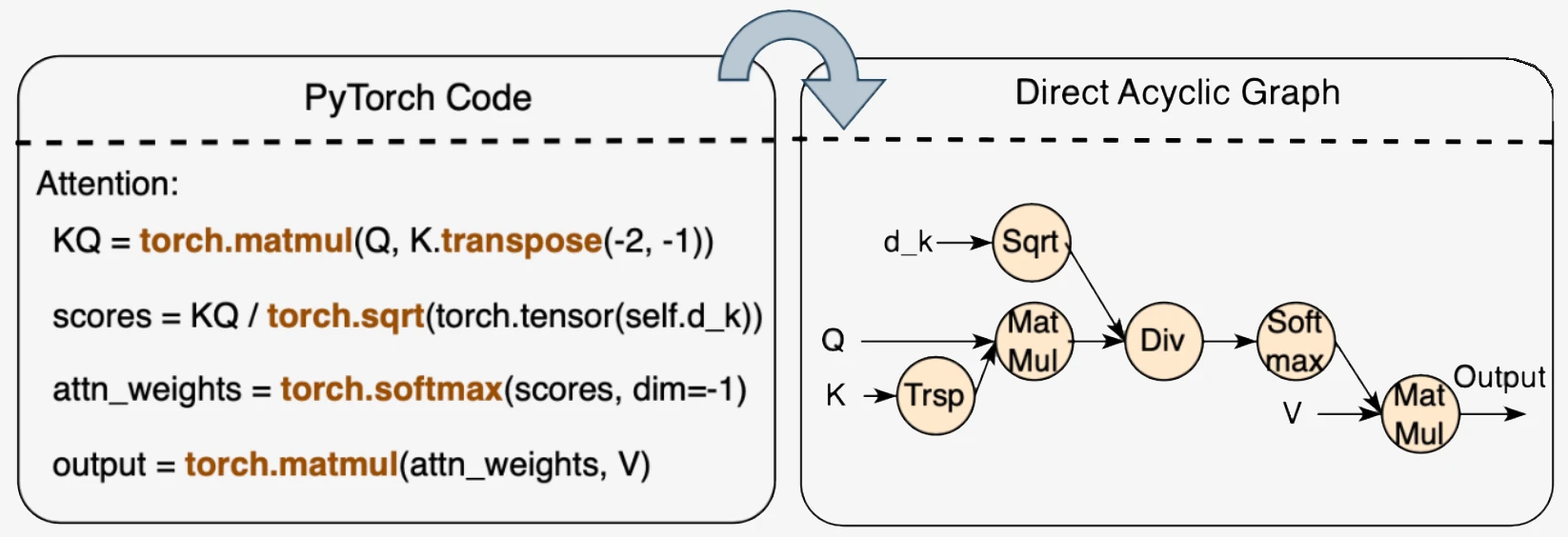

批处理优化(Batch Processing Optimization)

通过将多个推理任务打包为批次处理,显著降低整体计算复杂度,尤其适用于 Transformer 等语言模型中的序列式操作场景。如图 3 所示,传统的大语言模型(LLM)推理过程以逐 Token 生成方式运行,而 zkPyTorch 的创新方法则将全部输入输出 Token 聚合为单一 prompt 过程进行验证。这种处理方式能够一次性确认 LLM 的整体推理是否正确,同时确保每个输出 Token 与标准 LLM 推理一致。

在 LLM 推理中,KV cache(键值缓存)机制的正确性是保障推理输出可信性的关键。如果模型的推理逻辑有误,即便使用缓存,也无法还原出与标准解码流程一致的结果。zkPyTorch 正是通过精确复现这一流程,确保了零知识证明中的每一个输出都具备可验证的确定性与完整性。

图 3 :大规模语言模型(LLMs)计算的批量验证,其中 L 表示输入序列长度,N 表示输出序列长度,H 表示模型的隐藏层维度。

核心运算优化(Optimized Primitive Operations)

zkPyTorch 对底层机器学习原语进行了深度优化,极大地提升了电路效率。例如,卷积运算一向是计算密集型任务,zkPyTorch 采用基于快速傅里叶变换(FFT)的优化手法,将原本在空间域中执行的卷积,转换为频域中的乘法运算,显著降低计算成本。同时,针对 ReLU、softmax 等非线性函数,系统采用预计算查找表(lookup table)方式,规避了 ZKP 不友好的非线性计算,极大提升了推理电路的运行效率。

并行电路执行(Parallel Circuit Execution)

zkPyTorch 将复杂的 ML 运算自动编译为并行电路,充分释放多核 CPU/GPU 的硬件潜力,实现大规模并行证明生成。比如,在执行张量乘法时,zkPyTorch 会自动将计算任务拆分为多个独立子任务,并行分发至多个处理单元并发运行。这种并行化策略,不仅显著提升了电路执行吞吐量,还让大型模型的高效验证成为现实,为可扩展的 ZKML 打开了新维度。

全面性能实测:性能与精度的双重突破

zkPyTorch 通过严谨的基准测试,在多个主流机器学习模型中展现出卓越性能与实际可用性:

VGG-16 模型测试

在 CIFAR-10 数据集上,zkPyTorch 仅需 6.3 秒 即可完成单张图像的 VGG-16 证明生成,且在精度上与传统浮点计算相比几乎无差异。这标志着 zkML 在图像识别等经典任务中已经具备实战能力。

Llama-3 模型测试

针对规模高达 80 亿参数 的 Llama-3 大语言模型,zkPyTorch 实现了每个 token 约 150 秒 的高效证明生成。更令人瞩目的是,其输出结果与原始模型相比,保持了 99.32% 的余弦相似度,在保证高可信度的同时,仍兼顾模型输出的语义一致性。

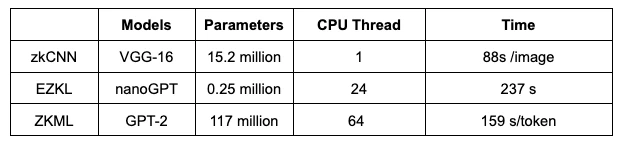

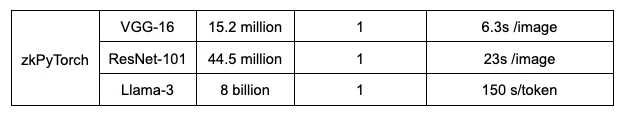

表 1 :各类 ZKP 方案在卷积神经网络与变换器网络中的性能表现

面向现实世界的广泛应用场景

可验证的机器学习即服务(Verifiable MLaaS)

随着机器学习模型的价值不断攀升,越来越多的 AI 开发者选择将自研模型部署到云端,向外提供 MLaaS(Machine-Learning-as-a-Service)服务。但在现实中,用户往往难以验证推理结果是否真实可信;而模型提供方也希望保护模型结构和参数等核心资产,避免被窃取或滥用。

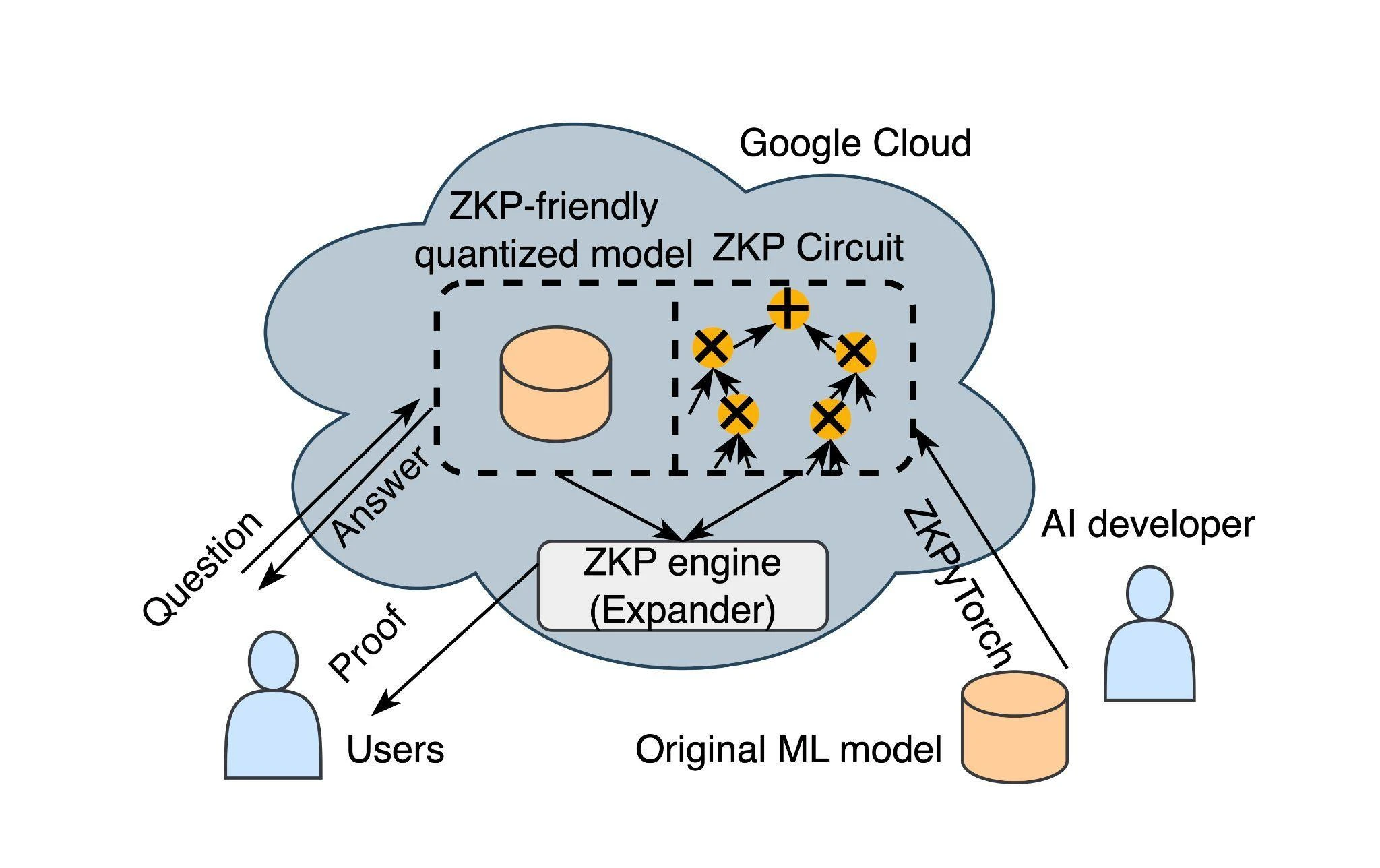

zkPyTorch 正是为解决这一矛盾而生:它让云端 AI 服务具备原生的“零知识验证能力”,实现推理结果的加密级别可验证。

如图 4 所示,开发者可将如 Llama-3 等大模型直接接入 zkPyTorch,构建具备零知识证明能力的可信 MLaaS 系统。通过与底层 ZKP 引擎无缝集成,zkPyTorch 能够在不暴露模型细节的前提下,自动生成证明,验证每一次推理是否被正确执行,从而为模型提供方和使用方建立真正可信的交互信任基础。

图 4 :zkPyTorch 在可验证机器学习即服务(Verifiable MLaaS)中的应用场景。

模型估值的安全护航

zkPyTorch 提供安全可验证的 AI 模型评估机制,使得利益相关方在不暴露模型细节的前提下,能够审慎评估其关键性能指标。这种“零泄露”的估值方式为 AI 模型确立了新的信任标准,在提升商业交易效率的同时,保障了开发者的知识产权安全。它不仅提高了模型价值的可见性,也为整个 AI 行业带来了更高的透明度与公正性。

与 EXPchain 区块链的深度集成

zkPyTorch 原生集成 Polyhedra Network 自主研发的 EXPchain 区块链网络,共同构建可信的去中心化 AI 基础设施。这一集成为智能合约调用和链上验证提供了高度优化的路径,使 AI 推理结果可以在区块链上获得加密验证并持久存证。

借助 zkPyTorch 与 EXPchain 的协同,开发者能够构建端到端可验证的 AI 应用,从模型部署、推理计算到链上验证,真正实现透明、可信且可审计的 AI 计算流程,为下一代区块链+AI 应用提供底层支撑。

未来路线图与持续创新

Polyhedra 将持续推进 zkPyTorch 的演进,重点聚焦以下方向:

开源与社区共建

逐步开源 zkPyTorch 核心组件,激发全球开发者参与,推动零知识机器学习领域的协同创新与生态繁荣。

拓展模型与框架兼容性

扩大对主流机器学习模型与框架的支持范围,进一步提升 zkPyTorch 的适配能力与通用性,使其可灵活嵌入各类 AI 工作流。

开发工具与 SDK 构建

推出全面的开发工具链与软件开发工具包(SDK),简化集成流程,加速 zkPyTorch 在实际业务场景中的部署与应用落地。

结语

zkPyTorch 是通向可信 AI 未来的重要里程碑。通过将成熟的 PyTorch 框架与前沿的零知识证明技术深度融合,zkPyTorch 不仅显著提升了机器学习的安全性与可验证性,更重塑了 AI 应用的部署方式与信任边界。

Polyhedra 将持续在“安全 AI”领域深耕创新,推动机器学习在隐私保护、结果可验证与模型合规方面迈向更高标准,助力构建透明、可信、可扩展的智能系统。

敬请关注我们不断发布的最新进展,见证 zkPyTorch 如何重塑安全智能时代的未来。

原文链接